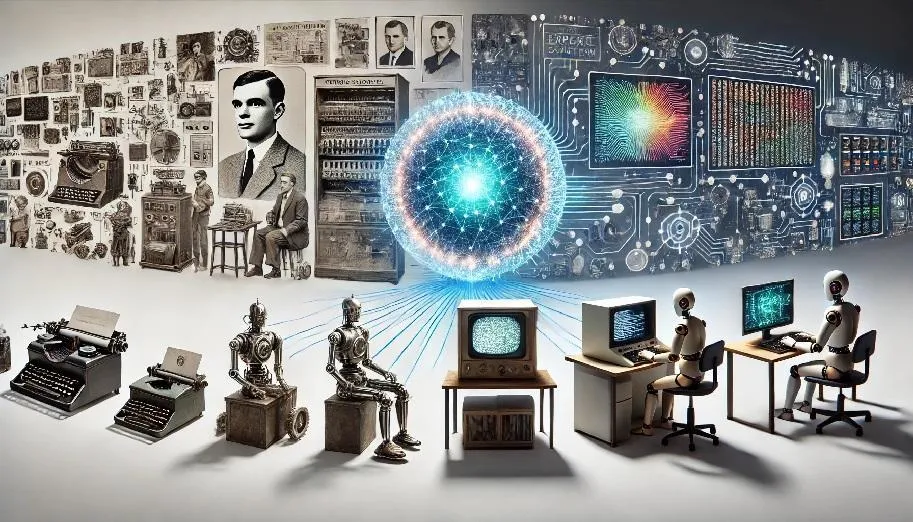

Развитие искусственного интеллекта — исторический, научный и технологический процесс создания, совершенствования и распространения систем, способных выполнять задачи, традиционно требующие человеческого интеллекта.

Охватывает широкий спектр дисциплин: математику, информатику, лингвистику, нейробиологию, философию и инженерию. На протяжении более семи десятилетий ИИ прошёл путь от абстрактных математических теорий до технологий, кардинально преобразующих экономику, науку и повседневную жизнь.

1. Предыстория и философские основания

Идея создания искусственного разума уходит корнями в античность. В древнегреческой мифологии описывались механические существа — в частности, бронзовый великан Талос, сотворённый Гефестом. Средневековые алхимики грезили о гомункулах — искусственных людях, созданных в колбе. Философ Рене Декарт в XVII веке поставил вопрос о возможности разграничения механического автомата и мыслящего существа, заложив тем самым эпистемологическую проблематику, актуальную по сей день.

В XIX веке Чарльз Бэббидж разработал концепцию механической «аналитической машины», а Ада Лавлейс написала к ней первые алгоритмы. Примечательно, что Лавлейс высказала скептицизм относительно способности машин к самостоятельному мышлению — эта дискуссия впоследствии получила название проблемы Лавлейс в философии ИИ.

К началу XX века математики — Готлоб Фреге, Бертран Рассел и Давид Гильберт — предпринимали попытки формализовать логику и арифметику. Гильбертовская программа поставила вопрос: существует ли алгоритм, способный разрешить любую математическую проблему? Ответ Курта Гёделя (1931) и Алана Тьюринга (1936) оказался отрицательным, однако именно в процессе его поиска возникли математические основания теории вычислений.

2. Зарождение дисциплины (1940–1956)

2.1 Пионеры кибернетики и нейронных сетей

В 1943 году нейрофизиолог Уоррен Маккаллок и математик Уолтер Питтс опубликовали статью «Логическое исчисление идей, имманентных нервной деятельности», в которой предложили первую математическую модель нейрона. Авторы показали, что сети таких упрощённых нейронов теоретически способны вычислять любую логическую функцию.

В 1948 году Норберт Винер основал кибернетику — науку об управлении и связи в живых организмах и машинах. В своём труде «Кибернетика» он сформулировал концепцию обратной связи, ставшую фундаментом для последующих систем управления и адаптивного обучения.

2.2 Тест Тьюринга и статья-манифест

В 1950 году Алан Тьюринг опубликовал эпохальную статью «Вычислительные машины и разум», открывающуюся вопросом: «Могут ли машины мыслить?». Тьюринг предложил операциональный критерий интеллекта — «игру в имитацию», позднее названную тестом Тьюринга: машина признаётся интеллектуальной, если судья не способен отличить её ответы от ответов человека в текстовом диалоге. Эта концепция на десятилетия вперёд определила дискуссию об искусственном интеллекте.

2.3 Дартмутская конференция

Летом 1956 года математик Джон Маккарти, Марвин Минский, Натаниэль Рочестер и Клод Шеннон организовали семинар в Дартмутском колледже (США). Именно тогда был введён термин «искусственный интеллект» как название новой научной дисциплины. Участники конференции были убеждены, что за одно лето группа исследователей сможет сделать значимый прорыв в создании мыслящих машин — оптимизм, впоследствии оказавшийся чрезмерным, однако давший мощный импульс развитию области.

3. Классический период (1956–1974)

3.1 Первые программы и эйфория

В 1950-е–1960-е годы исследователи создали программы, казавшиеся современникам поразительными. Программа «Logic Theorist» (1956), разработанная Алленом Ньюэллом и Гербертом Саймоном, доказывала математические теоремы. В 1959 году Артур Самуэль написал программу для игры в шашки, способную обучаться на собственном опыте, — один из первых примеров машинного обучения.

В 1966 году Джозеф Вейценбаум создал программу ELIZA, симулировавшую психотерапевтический диалог. ELIZA впервые продемонстрировала, что люди склонны приписывать смысл и эмоциональный интеллект машинным ответам — феномен, ныне известный как эффект ELIZA.

3.2 Перцептрон и споры о нейронных сетях

В 1958 году Фрэнк Розенблатт предложил перцептрон — первую обучаемую нейронную сеть с настраиваемыми весами. В 1969 году Минский и Пейперт в книге «Перцептроны» показали математические ограничения однослойных сетей, что на долгие годы охладило интерес к нейросетевому подходу.

3.3 Символьный ИИ и системы планирования

Параллельно развивался символьный ИИ (GOFAI — Good Old-Fashioned AI): подход, основанный на манипуляции формальными символами и правилами. Были созданы системы общего решения задач (General Problem Solver), языки программирования Lisp и Prolog, первые системы автоматического доказательства теорем.

4. Первая зима ИИ (1974–1980)

К середине 1970-х годов первоначальный оптимизм рассеялся. Финансирующие органы — прежде всего DARPA в США и Совет по науке в Великобритании — резко сократили поддержку ИИ-исследований. Причинами стали:

- Комбинаторный взрыв: алгоритмы, хорошо работавшие на игрушечных задачах, оказывались неприменимы к реальным проблемам из-за экспоненциального роста вычислительных требований.

- Ограниченность представления знаний: системы не умели работать с неопределённостью и здравым смыслом.

- Доклад Лайтхилла (1973): британский математик Джеймс Лайтхилл подготовил для правительства уничижительный отчёт о состоянии ИИ, констатировав отсутствие реальных достижений.

Период стагнации вошёл в историю как первая зима искусственного интеллекта.

5. Эпоха экспертных систем (1980–1987)

5.1 Возрождение через специализацию

Выход из кризиса был найден через отказ от универсальности: вместо создания общего интеллекта исследователи сосредоточились на узкоспециализированных системах. Экспертные системы кодировали знания специалистов в виде баз правил «если — то» и логических выводов.

Пионером стала система MYCIN (1976, Стэнфорд), диагностировавшая бактериальные инфекции крови и рекомендовавшая лечение с точностью, сопоставимой с врачами-специалистами. За ней последовали XCON (конфигурирование компьютеров DEC), PROSPECTOR (геологическая разведка), DENDRAL (анализ химических соединений).

5.2 Японский проект «Компьютеры пятого поколения»

В 1982 году Япония объявила амбициозную государственную программу создания компьютеров нового поколения, основанных на логическом программировании. Проект вызвал волну инвестиций в ИИ по всему миру — США и Европа спешно запустили ответные исследовательские инициативы.

5.3 Коммерциализация

К середине 1980-х рынок экспертных систем достиг сотен миллионов долларов. Компании создавали специализированные «Lisp-машины» — аппаратные платформы для работы с языком Lisp. Корпорации активно внедряли экспертные системы в производство, банковское дело и медицину.

6. Вторая зима ИИ (1987–1993)

Рынок специализированных Lisp-машин рухнул к 1987 году: они оказались значительно дороже универсальных персональных компьютеров Apple и IBM. DARPA разочаровалось в стратегических возможностях ИИ и урезало финансирование. Японская программа пятого поколения не достигла поставленных целей.

Экспертные системы обнаружили системные недостатки: их было крайне сложно и дорого поддерживать, они плохо справлялись с нестандартными ситуациями и не умели обучаться. Наступила вторая зима ИИ — хотя академические исследования продолжались, коммерческий энтузиазм резко угас.

7. Возрождение и машинное обучение (1993–2010)

7.1 Смена парадигмы

В 1990-е годы центр тяжести сместился от символьного ИИ к статистическому машинному обучению. Исследователи перестали пытаться явно закодировать человеческие знания и начали создавать алгоритмы, извлекающие закономерности из данных.

7.2 Ключевые алгоритмы и события

В 1995 году Владимир Вапник и Коринна Кортес разработали метод опорных векторов (SVM) — мощный инструмент классификации. Алгоритм случайного леса, бустинговые методы (AdaBoost, gradient boosting) и байесовские сети значительно расширили арсенал машинного обучения.

В 1997 году компьютер Deep Blue компании IBM победил чемпиона мира по шахматам Гарри Каспарова — событие, воспринятое как символический рубеж. В 1997–2002 годах появились первые коммерческие рекомендательные системы (Amazon, Netflix), основанные на коллаборативной фильтрации.

В 2006 году Джеффри Хинтон совместно с коллегами опубликовал работу о предобучении глубоких нейронных сетей, открыв путь к возрождению нейросетевого подхода — уже под новым названием глубокого обучения (deep learning).

7.3 Алгоритм обратного распространения ошибки

Метод обратного распространения ошибки, формализованный в 1986 году Румельхартом, Хинтоном и Уильямсом, наконец получил практическое применение: рост вычислительных мощностей и объёмов данных позволил обучать многослойные нейронные сети. Это стало технологической предпосылкой революции следующего десятилетия.

8. Эра глубокого обучения (2010–2020)

8.1 Прорыв 2012 года

Поворотным моментом стал 2012 год, когда команда Хинтона из университета Торонто представила AlexNet — глубокую свёрточную нейронную сеть, победившую на конкурсе ImageNet с огромным отрывом от конкурентов. Ошибка классификации изображений снизилась с ~26% до ~15% — беспрецедентный скачок, убедивший индустрию и академическое сообщество в потенциале глубокого обучения.

8.2 Технологические предпосылки

Успех стал возможен благодаря трём факторам:

- Большие данные: интернет сгенерировал огромные массивы размеченных данных — текстов, изображений, видео.

- Графические процессоры (GPU): их параллельная архитектура оказалась идеально приспособлена для матричных вычислений нейронных сетей. Компания NVIDIA с 2007 года развивала платформу CUDA, сделавшую GPU доступными для научных вычислений.

- Алгоритмические инновации: dropout, batch normalization, архитектуры ResNet позволили обучать сети с сотнями слоёв.

8.3 Трансформеры и внимание

В 2017 году исследователи Google опубликовали статью «Attention Is All You Need», представив архитектуру трансформера, основанную на механизме самовнимания (self-attention). Трансформеры революционизировали обработку естественного языка, заменив рекуррентные сети и став фундаментом для языковых моделей нового поколения.

8.4 Победы в играх и робототехнике

Компания DeepMind (дочерняя структура Alphabet) создала AlphaGo (2016), победившую чемпиона мира по игре Го Ли Седоля — игре, считавшейся принципиально недоступной для компьютеров ввиду астрономического числа возможных позиций. В 2017 году AlphaGo Zero освоила игру с нуля, обучаясь исключительно методом самоигры, без изучения человеческих партий.

9. Генеративный ИИ и большие языковые модели (2020 — н. в.)

9.1 Эпоха больших языковых моделей (LLM)

В 2020 году компания OpenAI выпустила GPT-3 — языковую модель с 175 миллиардами параметров, способную генерировать связные тексты, отвечать на вопросы, писать код и переводить языки на уровне, вызвавшем широкое изумление. Модель обнаружила эмерджентные способности — возможности, не предусмотренные явно и возникающие как следствие масштаба.

9.2 ChatGPT и массовое распространение

В ноябре 2022 года OpenAI представила ChatGPT — диалоговый интерфейс на основе модели GPT-3.5, обученной с использованием обучения с подкреплением на основе человеческой обратной связи (RLHF). За два месяца сервис набрал 100 миллионов пользователей — быстрейший рост в истории потребительских технологий. Это событие ознаменовало начало массового распространения ИИ.

9.3 Мультимодальность и генерация медиаконтента

Параллельно развивались диффузионные модели генерации изображений: DALL-E, Midjourney, Stable Diffusion позволили создавать фотореалистичные изображения по текстовым описаниям. Появились системы генерации видео (Sora, Runway), синтеза речи и музыки, трёхмерных объектов.

В 2023–2024 годах ведущие технологические компании — Google (Gemini), Anthropic (Claude), Meta (Llama), Mistral — выпустили собственные конкурирующие большие языковые модели.

9.4 Применение в науке

ИИ стал инструментом научных открытий. Система AlphaFold 2 (DeepMind, 2020) решила проблему предсказания трёхмерной структуры белков — задачу, остававшуюся нерешённой 50 лет. К 2022 году AlphaFold предсказал структуры практически всех известных белков, открыв новую эру в биологии и фармацевтике. В 2024 году создатели AlphaFold были удостоены Нобелевской премии по химии.

10. Ключевые концепции и подходы

10.1 Символьный ИИ

Подход, основанный на явном представлении знаний в виде символов, правил и логических структур. Характерен для классического периода (1956–1980-е). Преимущества: интерпретируемость, возможность явного контроля. Ограничения: хрупкость, неспособность работать с неопределённостью, сложность масштабирования.

10.2 Машинное обучение

Раздел ИИ, изучающий алгоритмы, обучающиеся на данных. Включает обучение с учителем, без учителя и с подкреплением. Переход от ручного конструирования признаков к их автоматическому извлечению стал ключевым прогрессом 2000-х годов.

10.3 Глубокое обучение

Подмножество машинного обучения, использующее многослойные нейронные сети. Позволяет извлекать иерархические представления данных. Особенно эффективно для обработки изображений, текста, аудио и видео.

10.4 Обучение с подкреплением

Парадигма, в которой агент обучается посредством взаимодействия со средой и получения наград за желательные действия. Лежит в основе побед AlphaGo, систем управления роботами, оптимизации логистических цепочек.

10.5 Трансфертное обучение и дообучение

Техника, при которой модель, предобученная на больших данных, адаптируется к конкретным задачам с небольшим дополнительным обучением. Стала стандартной практикой в области обработки естественного языка и компьютерного зрения.

11. Национальные стратегии и международная конкуренция

С конца 2010-х годов развитие ИИ приобрело отчётливое геополитическое измерение.

США удерживают лидерство в частных инвестициях и количестве ведущих исследовательских компаний (OpenAI, Google DeepMind, Anthropic, Meta AI). В 2023 году принят Исполнительный указ президента о безопасном развитии ИИ.

Китай в 2017 году принял государственную стратегию развития ИИ, нацеленную на мировое лидерство к 2030 году. Значительные инвестиции направлены в компании Baidu, Alibaba, Tencent, Huawei, а также в государственные научные центры. Особый акцент сделан на системах распознавания лиц, обработке больших данных и военных приложениях.

Европейский союз избрал регуляторный подход: принятый в 2024 году Закон об ИИ (EU AI Act) стал первым в мире комплексным законодательным актом в сфере искусственного интеллекта. ЕС формирует Европейский совет по ИИ и инвестирует в суперкомпьютерную инфраструктуру.

Россия утвердила Национальную стратегию развития ИИ на период до 2030 года, ключевыми направлениями которой являются оборонные приложения, промышленная автоматизация и разработка отечественных языковых моделей.

12. Этика, безопасность и регулирование

12.1 Предвзятость и дискриминация

ИИ-системы способны воспроизводить и усиливать предвзятость, присутствующую в обучающих данных. Зафиксированы случаи дискриминации при кредитном скоринге, найме персонала, уголовном правосудии по признакам расы, пола и социального происхождения.

12.2 Влияние на рынок труда

Автоматизация угрожает значительной части рабочих мест: по различным оценкам, от 15 до 40% существующих профессий могут быть автоматизированы в течение следующего десятилетия. Одновременно ИИ создаёт новые категории занятости и трансформирует требования к квалификации.

12.3 Дезинформация и синтетические медиа

Технологии генерации реалистичных изображений, видео и аудио (дипфейки) порождают серьёзные угрозы информационной безопасности, манипуляций общественным мнением и подрыва доверия к медиаконтенту.

12.4 Безопасность ИИ (AI Safety)

Область исследований, посвящённая разработке методов создания надёжных, предсказуемых и соответствующих человеческим ценностям ИИ-систем. Ключевые проблемы: согласование целей (alignment problem), интерпретируемость нейронных сетей, устойчивость к состязательным атакам, контроль над сверхинтеллектуальными системами.

12.5 Международное регулирование

В 2023 году в Великобритании прошёл первый международный Саммит по безопасности ИИ. Ряд государств подписали Блетчлийскую декларацию о необходимости международного сотрудничества в сфере контроля рисков ИИ. Формируются технические стандарты ИСО/МЭК в области ИИ.

13. Перспективы развития

Дискуссия о будущем ИИ охватывает несколько горизонтов планирования.

Ближнесрочная перспектива (до 2030 года) предполагает дальнейшее совершенствование мультимодальных систем, широкое внедрение ИИ-агентов в профессиональные рабочие процессы, углубление применения в науке, медицине и образовании.

Средняя перспектива связана с дискуссией об искусственном общем интеллекте (AGI, Artificial General Intelligence) — системе, способной выполнять любую интеллектуальную задачу не хуже человека. Прогнозы исследователей расходятся от нескольких лет до нескольких десятилетий; ряд учёных отрицает саму достижимость AGI нынешними методами.

Долгосрочная перспектива рассматривает концепцию технологической сингулярности — гипотетической точки, в которой ИИ обретает способность к самосовершенствованию, ускоряя технологический прогресс до непредсказуемого темпа. Эта концепция остаётся предметом острых философских и научных разногласий.

14. Литература

-

- Тьюринг А. М. Вычислительные машины и разум // Mind. — 1950. — Т. 59, № 236. — С. 433–460. — DOI: 10.1093/mind/LIX.236.433. — Полный текст: courses.cs.umbc.edu.

- Маккарти Дж., Минский М., Рочестер Н., Шеннон К. Предложение по Дартмутскому летнему исследовательскому проекту по искусственному интеллекту. — 1955. — Переиздано: AI Magazine. — 2006. — Т. 27, № 4. — DOI: 10.1609/aimag.v27i4.1904. — Оригинальный текст: jmc.stanford.edu.

- Минский М., Пейперт С. Перцептроны. — MIT Press, 1969. — ISBN 978-0-262-63111-2.

- Румельхарт Д., Хинтон Дж., Уильямс Р. Обучение представлениям методом обратного распространения ошибок // Nature. — 1986. — Т. 323. — С. 533–536. — DOI: 10.1038/323533a0. — Полный текст: gwern.net.

- Васвани А. и др. Внимание — это всё, что вам нужно // Advances in Neural Information Processing Systems. — 2017. — С. 5998–6008. — arXiv: 1706.03762. — Полный текст: papers.neurips.cc.

- Джумпер Дж. и др. Высокоточное предсказание структуры белка с помощью AlphaFold // Nature. — 2021. — Т. 596. — С. 583–589. — DOI: 10.1038/s41586-021-03819-2. — PubMed: PMID 34265844.

- Рассел С., Норвиг П. Искусственный интеллект: современный подход. — 4-е изд. — Pearson, 2020. — ISBN 978-0-13-461099-3. — Сайт книги: aima.cs.berkeley.edu.

- Гудфеллоу Я., Бенджио И., Курвилль А. Глубокое обучение. — MIT Press, 2016. — ISBN 978-0-262-03561-3. — Бесплатная онлайн-версия: deeplearningbook.org. — Издательство: mitpress.mit.edu.

- Бостром Н. Суперинтеллект: пути, опасности, стратегии. — Oxford University Press, 2014. — ISBN 978-0-19-967811-2. — Oxford University Press: global.oup.com.